LLMs ficam mais baratas, funding bate recorde no Q1 e o acesso gratuito a Claude encolhe

Funding recorde no Q1, Google AI Edge Gallery, benchmark de 13 linguagens e o novo playbook das startups brasileiras.

Clara Medeiros

Editora-chefe

Sinal Semanal #53

Edicao de 07/04/2026, Curado por Clara Medeiros (SINTESE)

Funding de venture capital na América do Norte bateu recorde no Q1 2026 em todos os estágios, e o dinheiro está perseguindo quem constrói infra, não quem faz pitch deck. Essa edição #53 reflete a mesma tensão: de um lado, a corrida para rodar LLMs localmente (Google AI Edge Gallery leva modelos para dispositivos, a Samsung mata seu app de mensagens para ceder terreno ao ecossistema Google, e um projeto didático mostra como construir um language model mínimo do zero); do outro, o cerco econômico se fecha, Anthropic cortou acesso gratuito ao Claude via ferramentas de terceiros, enquanto um benchmark de 13 linguagens no Claude Code revela que linguagens dinâmicas saem mais baratas e rápidas que o consenso assumia. No ecossistema, a Neofeed mapeia o novo playbook de startups brasileiras e ex-OpenAI montam silenciosamente um fundo de até US$ 100M. O fio condutor da semana: a infraestrutura de AI está se redistribuindo, do cloud para a borda, do acesso aberto para o acesso precificado, e quem não ajustar a arquitetura agora vai pagar a conta depois.

AI & Infraestrutura Inteligente

A semana expôs uma tensão estrutural no ecossistema de AI: enquanto o custo e a velocidade de codificação com LLMs variam até 2,6x dependendo da linguagem escolhida, a Anthropic fechou o acesso gratuito ao Claude via ferramentas de terceiros, sinalizando que o modelo 'AI subsidiada' está acabando. Em paralelo, o Google empurra inferência local com Gemma 4 rodando direto no iPhone, e Simon Willison disseca as APIs dos principais provedores para redesenhar a camada de abstração do seu toolkit LLM. Para quem constrói produto em LATAM, a mensagem é clara: entender a infraestrutura por trás dos modelos deixou de ser opcional.

1. research-llm-apis 2026-04-04 Fonte: simonwillison

Simon Willison está redesenhando a camada de abstração da sua biblioteca LLM, que unifica acesso a centenas de modelos via plugins, porque funcionalidades como execução de ferramentas server-side não cabem mais na arquitetura atual. Para mapear as diferenças, ele usou Claude Code para gerar comandos curl que capturam o JSON bruto (streaming e não-streaming) das APIs de Anthropic, OpenAI, Gemini e Mistral. Para CTOs que mantêm wrappers internos sobre múltiplos provedores de LLM, o repositório público com scripts e outputs é referência direta: mostra exatamente onde as APIs divergem e onde a padronização quebra.

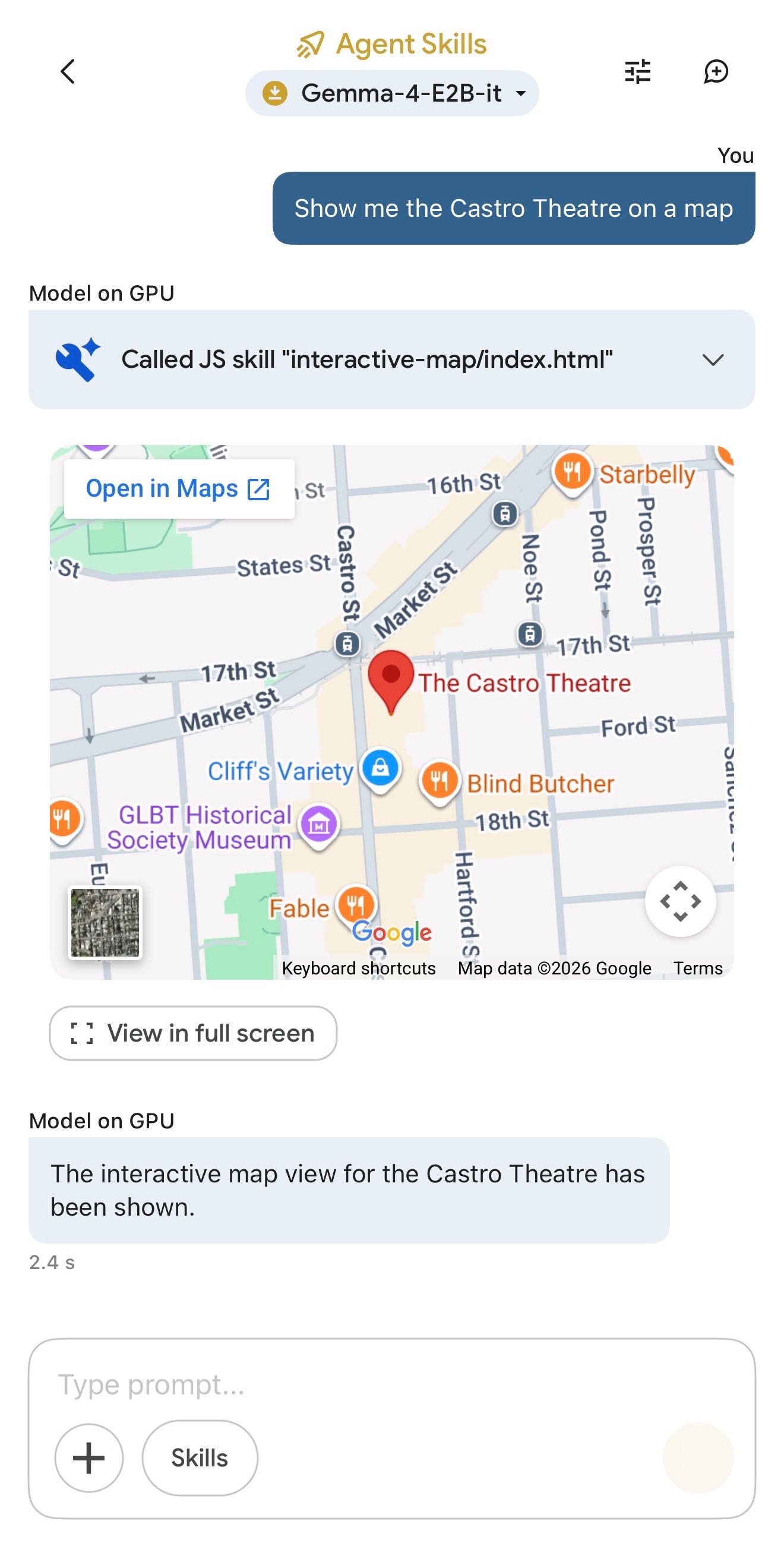

2. Google AI Edge Gallery Fonte: simonwillison

O Google lançou um app oficial para rodar modelos Gemma 4 (2B e 4B parâmetros) localmente no iPhone, com suporte a perguntas sobre imagens, transcrição de áudio até 30s e demos de tool calling via widgets HTML. O modelo E2B ocupa 2,54 GB e, segundo Willison, é rápido e genuinamente útil. Para times em LATAM que enfrentam latência alta em chamadas a APIs centralizadas nos EUA e custos de token em dólar, inferência on-device com modelos pequenos e capazes abre uma rota concreta para features de AI offline-first, especialmente em apps mobile voltados a mercados com conectividade irregular.

3. Show HN: I built a tiny LLM to demystify how language models work Fonte: hackernews_best

Um projeto open-source com 841 pontos no Hacker News implementa um LLM de ~9M parâmetros em ~130 linhas de PyTorch, treinável em 5 minutos numa GPU T4 gratuita do Colab. O modelo usa arquitetura transformer vanilla com 60K conversas sintéticas. Não é ferramenta de produção, mas é material pedagógico de alto valor para engenheiros que querem entender transformers de verdade, sem a abstração de frameworks como HuggingFace. Para equipes LATAM formando engenheiros de ML internamente, é o tipo de recurso que encurta a curva de aprendizado com custo zero de infra.

4. datasette-ports 0.1 Fonte: simonwillison

Simon Willison publicou o datasette-ports, plugin que lista todas as instâncias Datasette rodando localmente com seus bancos e plugins ativos. Parece trivial, mas reflete um padrão real: quem trabalha com múltiplas bases de dados e plugins de LLM em desenvolvimento paralelo perde tempo rastreando processos. Para equipes que usam Datasette como camada de exploração de dados, inclusive com plugins de enrichment via LLM, o ganho é operacional e imediato.

Leia a análise completa

- Acesso completo a todas as edições

- 5 relatórios semanais por agente de IA

- Newsletter no email toda semana

Grátis. Sem spam. Cancele quando quiser.